I. บทสรุปสำหรับผู้บริหาร: คำสั่งเชิงกลยุทธ์ในการเป็นผู้นำด้าน AI Coding

การบูรณาการเครื่องมือปัญญาประดิษฐ์ (AI) เข้ากับวงจรการพัฒนาซอฟต์แวร์ได้นำมาซึ่งการเปลี่ยนแปลงกระบวนทัศน์ครั้งสำคัญ ความได้เปรียบในการแข่งขันในยุคปัจจุบันไม่ได้วัดจากความเร็วในการสร้างโค้ดเท่านั้น แต่วัดจากความสามารถในการสร้างโค้ดที่ ปลอดภัย สอดคล้องตามกฎระเบียบ และมีสถาปัตยกรรมที่แข็งแกร่ง ได้ในวงกว้าง 1

AI โค้ดดิ้งมอบผลผลิตที่เพิ่มขึ้นอย่างมหาศาล ซึ่งมีการรายงานว่าสามารถเร่งความเร็วในการทำงานบางอย่างได้เร็วขึ้นถึง 55% 1 นอกจากนี้ ยังช่วยให้สามารถสร้างระบบที่ซับซ้อน (เช่น ระบบที่ใช้ฐานข้อมูล SQLite) ได้ภายในเวลาไม่กี่ชั่วโมง จากเดิมที่ต้องใช้เวลาหลายวันในการพัฒนาด้วยตนเอง 1 อย่างไรก็ตาม ความเร็วที่เพิ่มขึ้นนี้มาพร้อมกับความเสี่ยงที่ซ่อนอยู่และมีค่าใช้จ่ายสูง ซึ่งถูกเรียกว่า “หนี้ทางเทคนิคราคาแพงที่รอการปะทุ” 1 ความผิดพลาดที่เกิดจาก AI นั้นมักจะ “ละเอียดอ่อนแต่ร้ายแรง” และจะปรากฏออกมาก็ต่อเมื่อระบบถูกใช้งานจริงในสภาพแวดล้อมการผลิตเท่านั้น 1

วิทยานิพนธ์เพื่อสร้างธุรกิจมูลค่าพันล้านบาทนี้เน้นย้ำว่า โอกาสที่มีมูลค่าสูงไม่ได้อยู่ในแอปพลิเคชันสำหรับผู้บริโภคทั่วไป แต่คือการแก้ปัญหาที่มีค่าใช้จ่ายสูงและมีความเสี่ยงสูงในอุตสาหกรรมที่มีการกำกับดูแลอย่างเข้มงวด เช่น เทคโนโลยีทางการเงิน (FinTech) และเทคโนโลยีด้านสุขภาพ (HealthTech) 2 ในภาคส่วนเหล่านี้ ความล้มเหลวในการปฏิบัติตามมาตรฐาน เช่น HIPAA (สำหรับข้อมูลสุขภาพ) หรือ PCI DSS (สำหรับการประมวลผลการชำระเงิน) สามารถนำไปสู่การละเมิดกฎหมาย การถูกปรับครั้งใหญ่ และความล้มเหลวทางธุรกิจในที่สุด 1

ดังนั้น ข้อเสนอแนะหลักสำหรับผู้นำด้านเทคโนโลยีคือ การนำ กรอบการทำงานที่ยึดความปลอดภัยเป็นอันดับแรก (Security-First Framework) มาใช้เป็นข้อบังคับ การสร้างธุรกิจที่มีมูลค่าสูงและยั่งยืนจากการใช้ AI ในการเขียนโค้ดจำเป็นต้องมีวินัยที่เหนือกว่าในการตรวจสอบ, การทดสอบ, และการจัดการบริบททางสถาปัตยกรรมของโมเดลภาษาขนาดใหญ่ (LLMs) 1

II. การกำหนดความได้เปรียบในการแข่งขันในการพัฒนาซอฟต์แวร์ที่ใช้ AI

ความได้เปรียบเชิงกลยุทธ์ที่แท้จริงและศักยภาพในการประเมินมูลค่าที่เพิ่มขึ้น ไม่ได้มาจากจำนวนบรรทัดของโค้ดที่ผลิตได้ แต่มาจากการมีกระบวนการที่เหนือกว่าและมีความสมบูรณ์ทางสถาปัตยกรรม

II.A. ความย้อนแย้งด้านประสิทธิภาพการผลิต: ความเร็วเทียบกับความสมบูรณ์ของระบบ

เครื่องมือ AI สามารถสร้างโค้ดที่มีฟังก์ชันการทำงานที่รวดเร็วอย่างไม่น่าเชื่อ ทำให้การสร้างผลิตภัณฑ์ต้นแบบหรือระบบพื้นฐานทำได้อย่างว่องไว 1 อย่างไรก็ตาม ประสิทธิภาพนี้สามารถเป็นเพียงภาพลวงตาหากขาดความเข้าใจในบริบทที่กว้างขึ้นของสถาปัตยกรรมระบบ

ความผิดพลาดที่ร้ายแรงที่เกิดขึ้นในกระบวนการเขียนโค้ดด้วย AI มักเกิดจากสิ่งที่เรียกว่า “ความบอดต่อบริบท (Context Blindness)” 1 ตัวอย่างที่สำคัญคือ กรณีที่ AI สร้างระบบที่ใช้ฐานข้อมูล SQLite ที่ใช้งานได้ในขั้นต้น แต่เมื่อนำไปทดสอบภายใต้ภาระงานพร้อมกัน (Load Testing) ระบบเกิดภาวะล็อกฐานข้อมูลและหยุดทำงาน 1 ความผิดพลาดนี้เกิดจาก AI สร้างการดำเนินการเขียนพร้อมกัน (concurrent write operations) โดยไม่เข้าใจข้อจำกัดพื้นฐานทางสถาปัตยกรรมของ SQLite ซึ่งเป็นฐานข้อมูลที่รองรับการเขียนแบบผู้ใช้เดียว (single-writer database) เป็นหลัก 1 ความผิดพลาดประเภทนี้จะยิ่งร้ายแรงมากขึ้นเมื่อทำงานกับระบบแคชที่ซับซ้อน ซึ่งการขาดความเข้าใจในเรื่องการซิงโครไนซ์ข้อมูลอาจทำให้เกิดความเสียหายของข้อมูลได้

การวิเคราะห์เชิงลึกชี้ให้เห็นว่า หาก AI สามารถเร่งการส่งมอบฟังก์ชันการทำงานได้ แต่กลับนำไปสู่ความล้มเหลวในการทดสอบโหลด (ปัญหาความหน่วง/การล็อก) และสร้างความเสี่ยงด้านกฎระเบียบ (ช่องว่างในการตรวจสอบ/การไม่ปฏิบัติตามข้อกำหนด) จุดเน้นของการแข่งขันจึงต้องย้ายไป 1 นักพัฒนาจึงต้องจัดลำดับความสำคัญของตัวชี้วัดที่วัดความยืดหยุ่นของระบบ (เช่น การปราศจากการล็อกฐานข้อมูลภายใต้ภาระงาน) และความมั่นคงด้านความปลอดภัย (เช่น การตรวจสอบการปฏิบัติตามกฎระเบียบโดยอัตโนมัติ) เหนือกว่าตัวชี้วัดง่ายๆ เช่น จำนวนบรรทัดของโค้ด (LOC) หรือความเร็วในการทำงานให้เสร็จสิ้น 1 นี่คือคำจำกัดความของการสร้างโค้ดคุณภาพสูงที่พร้อมสำหรับการใช้งานในระดับการผลิต (Production-Ready Code) 3

II.B. คุณภาพและมาตรวัดทางสถาปัตยกรรม

ผลการศึกษาเปรียบเทียบคุณภาพโค้ดที่สร้างโดยเครื่องมือ AI ต่างๆ (เช่น Gemini Code Assist, GitHub Copilot, ChatGPT) แสดงให้เห็นถึงความผันแปรในระดับปานกลางถึงสูงในมาตรวัดที่สำคัญ เช่น ความซับซ้อนเชิงวงจร (Cyclomatic Complexity), จำนวนบรรทัดของโค้ด, และ ความซับซ้อนทางการรับรู้ (Cognitive Complexity) 3 การค้นพบนี้เน้นย้ำว่า ไม่มีเครื่องมือ AI ตัวใดที่สามารถรับประกันได้ว่าจะสร้างโค้ดคุณภาพสูงอย่างสม่ำเสมอในทุกบริบทการพัฒนา (เช่น React Native เทียบกับ Kotlin) 3 การตรวจสอบของมนุษย์และการตรวจสอบความถูกต้องทางสถาปัตยกรรมจึงยังคงเป็นสิ่งจำเป็นอย่างยิ่ง

นอกจากนี้ ยังมีประเด็นเรื่อง ความท้าทายในการเชื่อถือ AI (The Challenge of AI Trust) ผู้เชี่ยวชาญในอุตสาหกรรมได้ระบุว่า วิศวกรอาวุโสอาจมองข้ามช่องโหว่ด้านความปลอดภัยที่ชัดเจน (เช่น คีย์ API ถูกฮาร์ดโค้ดไว้ใน JavaScript ส่วนหน้า) เนื่องจากพวกเขาไว้วางใจในผลลัพธ์ของ AI 1 นี่เป็นเพราะการตรวจสอบโค้ดที่สร้างโดย AI ต้องใช้แบบจำลองทางความคิดที่แตกต่างจากการตรวจสอบโค้ดที่เขียนโดยมนุษย์โดยสิ้นเชิง 1 หากไม่มีวินัยด้านความปลอดภัย โค้ดที่สร้างโดย AI แม้จะทำงานได้ดี ก็จะกลายเป็นหนี้ทางเทคนิคที่มีค่าใช้จ่ายสูงและรอวันที่จะระเบิดในสภาพแวดล้อมการผลิต 1

III. ชุดเครื่องมือของนักพัฒนามืออาชีพ: Prompt Engineering และ Autonomous Agents

การเป็นผู้เชี่ยวชาญด้านการเขียนโค้ดด้วย AI นั้นต้องการความเชี่ยวชาญทางเทคนิคในการสั่งการโมเดลภาษาขนาดใหญ่ (LLMs) อย่างมีประสิทธิภาพ รวมถึงการทำความเข้าใจข้อดีข้อเสียระหว่างความยืดหยุ่นของโมเดลกับการเจาะลึกความรู้เฉพาะด้าน

III.A. Prompt Engineering: ศิลปะของการสั่งการตามบริบท

Prompt Engineering (PE) คือกระบวนการปรับเปลี่ยนอินพุตเพื่อชี้นำผลลัพธ์ของโมเดลโดยไม่ต้องทำการฝึกฝนซ้ำที่มีค่าใช้จ่ายสูง 4 การใช้ PE นั้นใช้ทรัพยากรน้อยกว่าการ Fine-Tuning (FT) อย่างมาก 5

PE มีความสำคัญต่อความยืดหยุ่นและความสามารถในการทำซ้ำอย่างรวดเร็ว เนื่องจากสามารถเปลี่ยนงานที่ทำได้โดยเพียงแค่ปรับเปลี่ยน Prompt เท่านั้น ในทางตรงกันข้าม FT ต้องการการฝึกฝนซ้ำที่มีค่าใช้จ่ายด้านทรัพยากรสูงเมื่อต้องเปลี่ยนไปใช้โดเมนอื่น 4

ประสิทธิภาพของ PE ถูกจำกัดด้วยคุณภาพและโครงสร้างของ Prompt 4 ความล้มเหลวหลักของ AI คือ “ความบอดต่อบริบท” 1 ดังนั้นทักษะที่มีค่าที่สุดสำหรับนักพัฒนาที่ใช้ AI จึงเป็นความสามารถในการอธิบาย

การไหลของข้อมูลที่สมบูรณ์ จุดเชื่อมต่อ (integration points) และข้อจำกัดทางสถาปัตยกรรม ให้กับ LLM อย่างแม่นยำ 1 สิ่งนี้ยกระดับบทบาทของนักพัฒนาจากการเป็นผู้ลงมือใช้โค้ด ไปสู่การเป็นสถาปนิกโครงสร้างระดับสูงที่ต้องสื่อสาร “เจตจำนง” ของระบบอย่างชัดเจน

เพื่อรองรับการพัฒนาระดับการค้าที่มีวินัย เครื่องมือ Prompt Engineering เฉพาะทางจึงมีความจำเป็น เครื่องมือเหล่านี้ (เช่น Maxim AI, LangSmith, Vellum, PromptFlow) ถูกออกแบบมาเพื่อจัดการ Prompt, การกำหนดเวอร์ชัน, การเชื่อมโยง (chaining), และการประเมินผลลัพธ์ ซึ่งเป็นโครงสร้างพื้นฐานที่จำเป็นสำหรับการพัฒนาซอฟต์แวร์ที่มีระเบียบ 6 Maxim AI ถูกระบุว่าเป็นเครื่องมือที่สมบูรณ์ที่สุดสำหรับการสร้าง Agent จริง 6

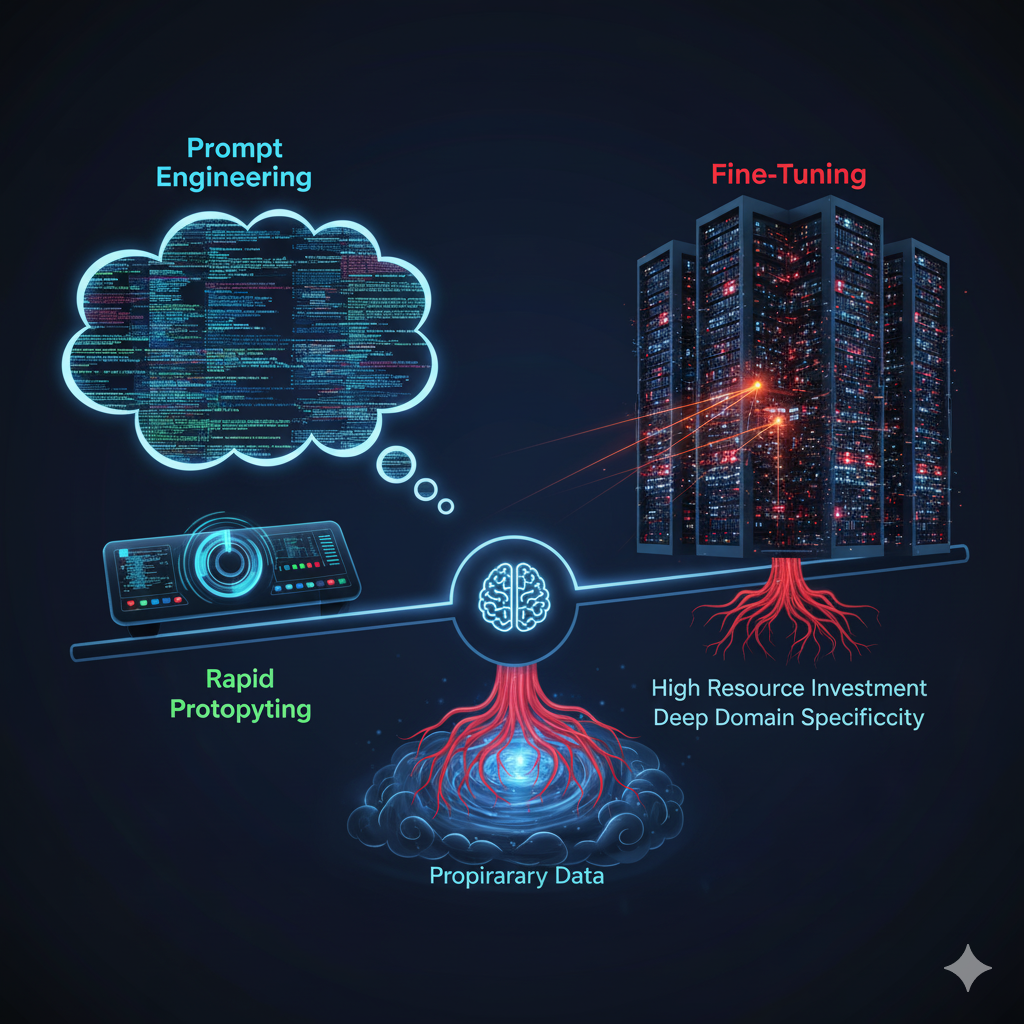

III.B. การเปรียบเทียบเชิงกลยุทธ์: Prompt Engineering เทียบกับ Fine-Tuning

การตัดสินใจว่าจะลงทุนอย่างมากในการจัดเก็บข้อมูลและการ Fine-Tuning หรือพึ่งพาการ Prompt ที่ยืดหยุ่น เป็นการตัดสินใจเชิงกลยุทธ์ที่สำคัญสำหรับธุรกิจที่ต้องการขยายขนาด การเปรียบเทียบนี้แสดงให้เห็นว่าควรใช้เทคนิคใดในขั้นตอนใดของการเติบโต

ตาราง การเปรียบเทียบเชิงกลยุทธ์ของการปรับแต่ง LLM สำหรับงานโค้ด

| คุณลักษณะ | Prompt Engineering (PE) | Fine-Tuning (FT) | นัยยะเชิงกลยุทธ์สำหรับสตาร์ทอัพ |

| การลงทุนด้านทรัพยากร | ต่ำ (ค่าใช้จ่ายในการอนุมาน ณ เวลาทำงาน) | สูง (การจัดหาข้อมูล, ต้นทุนการประมวลผล) | PE ช่วยให้สามารถทดลองได้อย่างรวดเร็ว (ค่าใช้จ่ายการลงทุนต่ำ) 4 |

| ความยืดหยุ่น/การปรับตัว | สูง (เปลี่ยนแปลงได้ทันที) | ต่ำ (ต้องทำการฝึกซ้ำ) | PE เหมาะสำหรับการทำซ้ำฟีเจอร์อย่างรวดเร็วและงานทั่วไป 4 |

| ความแม่นยำ/ความจำเพาะเจาะจง | ถูกจำกัดด้วยบริบทก่อนการฝึกฝน | สูง (การเจาะลึกความรู้เฉพาะโดเมน) | FT จำเป็นสำหรับงานเฉพาะทางที่ต้องการความรู้เชิงลึก (เช่น อัลกอริทึมทางการเงินที่เป็นกรรมสิทธิ์ หรือ API ระบบดั้งเดิมภายใน) 4 |

| เวลาในการปรับใช้ | ชั่วโมง/วัน | สัปดาห์/เดือน | PE มีความสำคัญต่อการรักษาความเร็วในการพัฒนาและตอบสนองต่อตลาดอย่างรวดเร็ว |

การสร้างธุรกิจมูลค่าพันล้านต้องใช้กลยุทธ์แบบผสม (Hybrid Strategy) ในช่วงเริ่มต้น สตาร์ทอัพควรใช้ PE เพื่อให้สามารถหาความเหมาะสมของผลิตภัณฑ์กับตลาด (Product-Market Fit) ได้อย่างรวดเร็วและประหยัด 4 อย่างไรก็ตาม เพื่อสร้างกำแพงทรัพย์สินทางปัญญา (IP moat) ที่สามารถป้องกันคู่แข่งได้ในภาคส่วนที่มีการกำกับดูแล พวกเขาจะต้องลงทุนในการ Fine-Tuning ด้วยชุดข้อมูลที่เป็นกรรมสิทธิ์และเฉพาะเจาะจงด้านการปฏิบัติตามกฎระเบียบ 4 ตัวอย่างเช่น การ Fine-Tuning ด้วยข้อมูลการตรวจจับการฉ้อโกงที่ไม่เปิดเผยตัวตน หรือโครงสร้าง FHIR (สำหรับ HealthTech) จะช่วยให้ได้ความแม่นยำและความจำเพาะเจาะจงที่ PE ไม่สามารถให้ได้ 4 ความคิดที่จะสร้างธุรกิจพันล้านจึงขึ้นอยู่กับการสร้างความแม่นยำจากข้อมูลที่เป็นกรรมสิทธิ์ร่วมกับการ Fine-Tuning ในระยะต่อมา

III.C. Autonomous Coding Agents และข้อจำกัดทางเทคนิค

Autonomous Agents หรือ Agent ที่ดำเนินการเขียนโค้ดได้ด้วยตนเอง (เช่น Copilot coding agent) เป็นตัวแทนของการพัฒนา AI ขั้นต่อไป 8 Agent เหล่านี้ต้องใช้

Model Context Protocol (MCP) ซึ่งเป็นมาตรฐานเปิดที่กำหนดวิธีการที่แอปพลิเคชันแบ่งปันบริบทกับ LLMs 9 MCP ช่วยให้ AI เชื่อมต่อกับแหล่งข้อมูลและเครื่องมือต่างๆ ได้อย่างเป็นมาตรฐาน เช่น การเข้าถึงข้อมูล GitHub หรือการเข้าถึงเว็บเพจผ่าน Playwright 9

แม้จะมีเครื่องมือที่ซับซ้อน แต่ระบบ Agentic ก็ยังมีโหมดความล้มเหลวที่สามารถทำนายได้และต้องได้รับการจัดการอย่างเข้มงวด 10 ความล้มเหลวหลักประกอบด้วย:

- ข้อจำกัดของ Context Window: Agent สูญเสียส่วนหนึ่งของการสนทนา ทำให้การตอบสนองไม่เชื่อมโยงกับการโต้ตอบครั้งก่อนหน้า (เช่น เมื่อมีการป้อนไฟล์ HTML ขนาดใหญ่เกินไป) 10

- การทำซ้ำขั้นตอน (Step Repetitions): เกิดขึ้นเนื่องจากการกำหนดค่าการโต้ตอบที่ตายตัว ทำให้ Agent วนซ้ำขั้นตอนเดิมโดยไม่มีความคืบหน้า 11

- ความล้มเหลวในการปฏิบัติตามข้อกำหนดของงาน: Agent ล้มเหลวในการปฏิบัติตามข้อกำหนดของงานที่กำหนดไว้โดยเฉพาะ 11

- ปัญหาการจัดรูปแบบ (Formatting Issue): ผลลัพธ์ของ Agent มีข้อมูลที่ไม่เกี่ยวข้องหรือไม่สอดคล้องกับรูปแบบที่กำหนด (เช่น คาดหวังตัวเลขแต่ได้ประโยคออกมา) 10

ความล้มเหลวเหล่านี้บ่งชี้ว่า Agent มีพลังมหาศาลสำหรับการทำงานอัตโนมัติ 8 แต่ไม่สามารถไว้วางใจให้ทำการตัดสินใจทางสถาปัตยกรรมที่สำคัญ หรือการ Refactoring ที่มีความเสี่ยงสูงได้โดยไม่มีการกำกับดูแลของมนุษย์ และการปฏิบัติตามหลักการ “การยอมรับด้วยตนเอง (Manual Acceptance)” ของ Security-First Framework 1

IV. กรอบการทำงานที่ยึดความปลอดภัยเป็นอันดับแรก: การออกแบบความน่าเชื่อถือในระบบที่สร้างโดย AI

ส่วนนี้เป็นหัวใจสำคัญของรายงาน ซึ่งเปลี่ยนการวิเคราะห์ความเสี่ยงให้เป็นเอกสารกระบวนการบังคับสำหรับธุรกิจที่ต้องการขยายขนาด วินัยด้านความปลอดภัยเป็นอุปสรรคที่ไม่ใช่ทางเทคนิคที่สำคัญที่สุดในการบรรลุการประเมินมูลค่าสูง

IV.A. การวินิจฉัยโหมดความล้มเหลวที่ก่อให้เกิดหายนะ

AI มุ่งเน้นไปที่ฟังก์ชันการทำงาน (Functionality) เป็นหลัก โดยละเลยบริบทด้านความปลอดภัย ซึ่งนำไปสู่ความล้มเหลวที่มีค่าใช้จ่ายสูงในสภาพแวดล้อมการผลิต 1

- ความบอดต่อบริบท (Context Blindness): โค้ดที่สร้างขึ้นอาจทำงานได้ดีในสภาวะแยกส่วน แต่จะทำลายรูปแบบการบูรณาการทางสถาปัตยกรรมที่กว้างขึ้น 1 ตัวอย่างที่เป็นแบบอย่างคือปัญหาความเข้ากันได้ของการทำงานพร้อมกันกับฐานข้อมูลที่ทำงานแบบผู้ใช้คนเดียว (SQLite) ซึ่งเกิดขึ้นและส่งผลกระทบต่อระบบอย่างชัดเจนภายใต้การทดสอบโหลดเท่านั้น 1

- ความล้มเหลวของรูปแบบความปลอดภัย (Security Pattern Failures): AI มักจะพลาดกรณีขอบ (edge cases) ที่เกี่ยวข้องกับการจัดการความลับ (secret management), ข้อกำหนดในการเข้ารหัส, และขอบเขตการควบคุมการเข้าถึง 1 ตัวอย่างคือ การฮาร์ดโค้ดคีย์ API ในโค้ด 1 นักวิเคราะห์เปรียบเทียบว่า AI เป็นเหมือนนักพัฒนารุ่นเยาว์ที่ทำงานได้รวดเร็วมาก ซึ่งรู้จักไวยากรณ์แต่ขาดความเข้าใจในรูปแบบภัยคุกคามที่สมบูรณ์ 1

- ช่องว่างในการปฏิบัติตามกฎระเบียบ (Compliance Gaps): นี่เป็นอันตรายอย่างยิ่งในอุตสาหกรรมที่มีการควบคุม 1 AI อาจสร้างโค้ดที่ดูเหมือนจะทำงานได้และผ่านการทดสอบ แต่ในความเป็นจริงแล้วละเมิดข้อบังคับ เช่น ข้อกำหนด PCI DSS (สำหรับการชำระเงิน) หรือ GDPR/กฎการเก็บรักษาข้อมูล (Data Residency) 1 ตัวอย่างเช่น AI อาจสร้างโค้ดเพื่อประมวลผลหมายเลขบัตรเครดิต (PANs) แต่ไม่ได้ตรวจสอบให้แน่ใจว่าข้อมูลดังกล่าวถูกเข้ารหัสขณะจัดเก็บ ถูกแปลงเป็นโทเคนขณะส่ง และถูกยกเว้นจากไฟล์บันทึก (Log files) 1

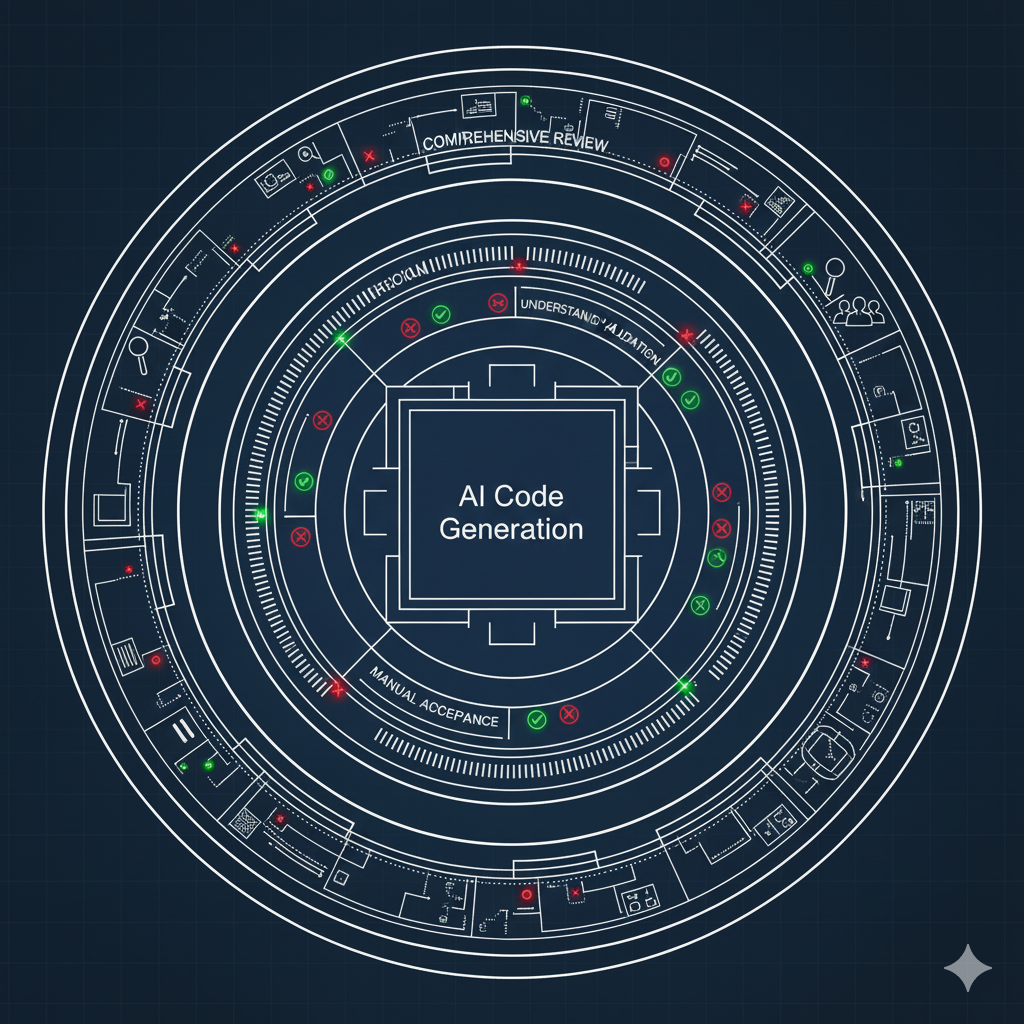

IV.B. กระบวนการพัฒนาที่มีโครงสร้าง (5 ขั้นตอนบังคับ)

กรอบการทำงานนี้เป็นข้อบังคับสำหรับทีมที่ต้องการนำโค้ดที่สร้างโดย AI ไปใช้งานจริง โดยเปลี่ยน AI ให้เป็นเครื่องมือที่ต้องอาศัยการกำกับดูแลจากผู้เชี่ยวชาญ 1

- การสร้างบริบท (Context Establishment): นักพัฒนาต้องให้ AI ทราบขอบเขตของปัญหาอย่างสมบูรณ์, ไฟล์ที่เกี่ยวข้อง, จุดเชื่อมต่อ, และ การไหลของข้อมูลทั้งหมด ว่าข้อมูลเคลื่อนที่อย่างไรและขอบเขตความปลอดภัยอยู่ที่ใด 1

- การตรวจสอบความเข้าใจ (Understanding Validation): นี่คือขั้นตอนที่สำคัญ ก่อนที่จะให้ AI สร้างโค้ด นักพัฒนาจะต้องขอให้ AI อธิบายขั้นตอนทั้งหมดกลับมา รวมถึงข้อจำกัดทางสถาปัตยกรรมที่จำเป็น เพื่อป้องกัน “ความผิดพลาดพื้นฐาน” เช่น ปัญหา SQLite locking 1

- การเปลี่ยนแปลงทีละน้อย (Incremental Changes): การเปลี่ยนแปลงจะต้องถูกจำกัดให้มีขนาดเล็กที่สุด 1 ห้ามขอให้ AI “Refactor ระบบการชำระเงินทั้งหมด” แต่ควรดำเนินการทีละขั้นตอน การเปลี่ยนแปลงทีละน้อยช่วยให้สามารถตรวจสอบย้อนกลับได้ง่ายขึ้น และควบคุมความซับซ้อน โดยเฉพาะอย่างยิ่งเมื่อทำงานกับระบบดั้งเดิม (Legacy Systems) 1

- การยอมรับด้วยตนเอง (Manual Acceptance): นักพัฒนาจะต้องตรวจสอบและยอมรับการแก้ไขที่เสนอโดย AI ด้วยตนเองทุกครั้ง และรักษาการควบคุมการเปลี่ยนแปลงทั้งหมดใน codebase ไว้ 1

- การตรวจสอบที่ครอบคลุม (Comprehensive Review): ก่อนที่จะทำการยืนยัน (Commit) โค้ด จะต้องมีการตรวจสอบร่วมกันเพื่อให้แน่ใจว่าโค้ดมีความถูกต้อง รักษาฟังก์ชันการทำงานที่มีอยู่ (รวมถึงการทำซ้ำ “บั๊ก” ที่อาจเป็นตรรกะทางธุรกิจที่สำคัญ) และปฏิบัติตามรูปแบบความปลอดภัยที่กำหนด 1 การตรวจสอบนี้มีความสำคัญยิ่งกว่าเดิมเมื่อโค้ดถูกสร้างโดย AI 1

IV.C. Compliance Engineering ในโค้ดที่ถูกกำกับดูแล

เส้นทางสู่ธุรกิจพันล้านใน FinTech หรือ HealthTech คือการสร้างความสามารถในการรับรองและทำงานด้านการปฏิบัติตามกฎระเบียบโดยอัตโนมัติ

1. การมุ่งเน้นใน FinTech (PCI DSS, AML, Fraud)

AI มีความเป็นเลิศในการตรวจจับความผิดปกติสำหรับการตรวจจับการฉ้อโกงและการปรับปรุงกระบวนการ KYC/AML ที่ซับซ้อนให้มีประสิทธิภาพมากขึ้น 12 การสร้างความน่าเชื่อถือในภาคส่วนนี้ต้องอาศัยการออกแบบสถาปัตยกรรมที่ใช้การไหลของข้อมูลการชำระเงินที่ถูกแปลงเป็นโทเคนตั้งแต่เริ่มต้น และการรักษาความปลอดภัยของ API ด้วยการเข้ารหัสและการตรวจสอบสิทธิ์ 2

การบรรเทาความเสี่ยง: การตรวจสอบความปลอดภัยที่ใช้ AI ช่วยเหลือจะต้องใช้ Prompt ด้านความปลอดภัยที่เฉพาะเจาะจง 1 เช่น การตรวจสอบโค้ดการประมวลผลการชำระเงินเพื่อดูว่าสอดคล้องกับ PCI DSS หรือไม่ โดยเฉพาะการตรวจสอบว่ามีการเข้ารหัสหมายเลขบัตรเครดิตขณะจัดเก็บและถูกยกเว้นจาก Log หรือไม่ 1 การกำกับดูแลของมนุษย์ยังคงเป็นสิ่งสำคัญในการตรวจสอบการประเมิน PCI DSS แม้ว่า AI จะเข้ามาช่วยในการทบทวนเอกสารและสร้างรายงานก็ตาม 13

2. การมุ่งเน้นใน HealthTech (HIPAA, Interoperability)

ข้อกำหนดบังคับใน HealthTech คือการสร้างสถาปัตยกรรมที่เน้นความเป็นส่วนตัวเป็นอันดับแรก พร้อมด้วยที่จัดเก็บข้อมูลที่เข้ารหัส, การติดตามการตรวจสอบ (audit tracking), และการใช้ API ที่ใช้มาตรฐาน FHIR เพื่อการแลกเปลี่ยนข้อมูลที่สอดคล้องกันระหว่างระบบ (เช่น EHRs, ห้องปฏิบัติการ) 2

ความเสี่ยงด้านกฎระเบียบ: AI อาจสร้างการกำหนดค่าโครงสร้างพื้นฐาน (เช่น Terraform) ที่ละเมิดข้อกำหนดการเก็บรักษาข้อมูลตามกฎหมาย (Data Residency) 1 ตัวอย่างเช่น การจำลองข้อมูลลูกค้าในยุโรปไปยังภูมิภาคในสหรัฐอเมริกา ซึ่งเป็นการละเมิด GDPR เว้นแต่จะได้รับคำสั่งอย่างชัดแจ้งเพื่อปฏิบัติตามกฎของหลายเขตอำนาจศาล 1

3. Compliance Risk Matrix for AI-Generated Code in Regulated Sectors

ตารางนี้สรุปความเสี่ยงด้านการปฏิบัติตามกฎระเบียบและกลยุทธ์การลดความเสี่ยงที่จำเป็นเมื่อใช้ AI ในการพัฒนาโค้ดสำหรับอุตสาหกรรมที่มีการกำกับดูแล

ตาราง เมทริกซ์ความเสี่ยงด้านการปฏิบัติตามกฎระเบียบสำหรับโค้ดที่สร้างโดย AI ในภาคส่วนที่มีการกำกับดูแล

| ภาคส่วน | ข้อบังคับหลัก | โหมดความล้มเหลวของ AI ที่สำคัญ | กลยุทธ์การบรรเทาความเสี่ยง (Security-First Framework) | อ้างอิง |

| FinTech | PCI DSS, AML/KYC | การบันทึก PAN ที่ละเอียดอ่อน; การไม่แปลงข้อมูลบัตรเป็นโทเคน; ปลายทาง API ที่ไม่ปลอดภัย | การสแกนความปลอดภัยอัตโนมัติ (Snyk); การตรวจสอบโดยใช้ AI ช่วยเหลือพร้อม Prompt PCI DSS เฉพาะ; การออกแบบโทเคนตั้งแต่ต้น | 1 |

| HealthTech | HIPAA, GDPR (การเก็บรักษาข้อมูล) | ขาดการเข้ารหัสหลายชั้น/การติดตามการตรวจสอบ; การกำหนดค่าโครงสร้างพื้นฐานที่ละเมิดการเก็บรักษาข้อมูล | พิมพ์เขียวสถาปัตยกรรมที่เน้นความเป็นส่วนตัว; การบังคับใช้ FHIR-based API; การกำหนดค่าโครงสร้างพื้นฐานที่คำนึงถึงการปฏิบัติตามกฎระเบียบ | 1 |

| DevSecOps (เครื่องมือภายใน) | SOC 2 | การฮาร์ดโค้ดความลับ (API keys ใน JS ส่วนหน้า); ความบอดต่อบริบท (ข้อบกพร่องของการทำงานพร้อมกัน) | การบูรณาการ Secret Management Vault; การทดสอบโหลดเพื่อค้นหาข้อบกพร่องในการทำงานพร้อมกัน; การตรวจสอบโดยเพื่อนร่วมงานที่เน้นแบบจำลองภัยคุกคาม | 1 |

การเปลี่ยน Compliance ให้เป็นคุณสมบัติของผลิตภัณฑ์ (RegTech): เนื่องจากช่องว่างด้านการปฏิบัติตามกฎระเบียบที่เกิดจากโค้ด AI ทั่วไป 1 และต้นทุนที่สูงของการดำเนินการตามกฎระเบียบด้วยตนเอง 12 จึงเกิดช่องว่างในตลาดสำหรับ

แพลตฟอร์ม RegTech ที่ใช้ AI เป็นหลัก 14 ระบบเหล่านี้จะใช้กรอบการทำงาน Security-First ภายในองค์กร ทำให้พวกเขาสามารถ

รับประกัน การสร้างโค้ดและการตรวจสอบการปฏิบัติตามกฎระเบียบได้ 14 การทำเช่นนี้เป็นการเปลี่ยนข้อบังคับที่จำเป็นให้เป็นบริการซอฟต์แวร์ที่มีอัตรากำไรสูง ซึ่งเป็นการสร้างเส้นทางที่ตรงสู่การประเมินมูลค่าระดับพันล้านบาท 15

V. วิทยานิพนธ์พันล้าน: โอกาสทางการตลาดและกลยุทธ์การขยายขนาด

การวิเคราะห์นี้มุ่งเน้นไปที่วิธีการสร้างรายได้จากความได้เปรียบที่ได้มาอย่างยากลำบากจากการมีระบบที่ปลอดภัย ปรับขนาดได้ และสร้างด้วย AI

V.A. การระบุช่องทางที่มีอัตรากำไรสูง

กลยุทธ์ที่ประสบความสำเร็จคือการมุ่งเน้นไปที่ภาคส่วนที่เผชิญกับหนี้ทางเทคนิคและความซับซ้อนสูง 2 ตัวอย่างที่โดดเด่นคือปัญหาความสามารถในการทำงานร่วมกันของ HealthTech (FHIR) และค่าใช้จ่ายด้านกฎระเบียบที่สูงใน FinTech 2

AI มีบทบาทสำคัญในการเร่งการพัฒนาผลิตภัณฑ์โดยการสร้างโมเดลจำลองอย่างรวดเร็วและการคาดการณ์ความเหมาะสมของผลิตภัณฑ์กับตลาด (Product-Market Fit) ซึ่งเป็นปัญหาทั่วไปและเป็นสาเหตุหลักที่ทำให้สตาร์ทอัพล้มเหลว 7 สิ่งนี้เป็นการนำความเร็วที่ได้จากการใช้ AI มาประยุกต์ใช้กับกลยุทธ์ทางธุรกิจโดยตรง ไม่ใช่แค่การเขียนโค้ด

ช่องทางแพลตฟอร์มการปฏิบัติตามกฎระเบียบ (Compliance Platform Niche): ผลิตภัณฑ์ที่มีมูลค่าสูงสุดอาจไม่ใช่ผลิตภัณฑ์ที่มุ่งเน้นผู้บริโภค แต่เป็นเครื่องมือสำหรับนักพัฒนาเฉพาะทางที่ บังคับใช้ แนวทางการเขียนโค้ดที่ปลอดภัยและสอดคล้องตามกฎระเบียบ และการตรวจสอบที่ครอบคลุมในองค์กรขนาดใหญ่ 1 ตัวอย่างเช่น ระบบ “Context-Aware Review System” ที่สามารถกำหนดค่าให้เข้าใจข้อกำหนดการปฏิบัติตามกฎระเบียบเฉพาะ (เช่น “โค้ดนี้ต้องเป็นไปตามข้อกำหนด SOC 2”) เพื่อเรียกใช้รายการตรวจสอบการตรวจสอบที่เกี่ยวข้อง 1

V.B. รูปแบบการสร้างรายได้สำหรับเครื่องมือ AI Developer

กลยุทธ์การกำหนดราคาต้องสอดคล้องกับมูลค่าที่รับรู้ของความปลอดภัยที่เพิ่มขึ้นและการรับประกันผลลัพธ์

Activity-Based เทียบกับ Outcome-Based Pricing: รูปแบบดั้งเดิมที่อิงตามกิจกรรม (เช่น ต่อจำนวนบรรทัดที่สร้าง, ต่อการเรียกใช้เซิร์ฟเวอร์) นั้นง่ายต่อการคาดการณ์และเจรจาต่อรอง 15 การศึกษาแสดงให้เห็นว่าลูกค้า 90% เลือกรูปแบบการกำหนดราคาตามกิจกรรมเนื่องจากความชัดเจนในการคาดการณ์ค่าใช้จ่าย 15

อนาคต: การกำหนดราคาตามผลลัพธ์ (Outcome-Based Pricing): รูปแบบที่มีมูลค่าสูงในอุดมคติคือการเรียกเก็บเงินตามผลลัพธ์ที่วัดได้จริง 15 เช่น ต่อการโต้ตอบของลูกค้าที่ได้รับการแก้ไขสำเร็จ, ต่อโอกาสทางธุรกิจที่มีคุณสมบัติเหมาะสม (qualified lead), หรือ

ต่อการหลีกเลี่ยงการค้นพบการตรวจสอบที่ไม่สอดคล้องตามกฎระเบียบ (audit finding averted) 15

ความท้าทายของการกำหนดราคาตามผลลัพธ์: รูปแบบนี้ต้องเผชิญกับความท้าทายในการดำเนินการ จำเป็นต้องมีการวัดผลที่แม่นยำ มีความหน่วงต่ำระหว่างการทำงานและผลลัพธ์ และความสามารถในการยืนยันความสำเร็จโดยอัตโนมัติ 15 ตัวอย่างเช่น Zendesk ใช้เวลาหลายเดือนในการทดลองเพื่อกำหนดว่า “การโต้ตอบของลูกค้าที่ได้รับการแก้ไขสำเร็จ” หมายความว่าอย่างไร และสร้างแผนภูมิขั้นตอน 7 ขั้นตอนเพื่อตัดสินใจสิ่งนี้โดยอัตโนมัติ 15

การสร้างรายได้จากวินัยด้านความปลอดภัย: หากบริษัทใช้กรอบการทำงาน Security-First เพื่อ รับประกัน การปฏิบัติตามข้อกำหนด PCI DSS ในโค้ดการชำระเงินที่สร้างขึ้น (เช่น รับประกัน 99.9% Compliance) พวกเขากำลังขายผลลัพธ์ที่วัดได้ (ความรับผิดตามกฎระเบียบที่ลดลง) การลดความเสี่ยงนี้เป็นปัจจัยที่ชอบธรรมสำหรับการกำหนดราคาตามผลลัพธ์ในระดับสูง 15 ตัวอย่างเช่น การเรียกเก็บค่าธรรมเนียมสูงต่อ “ช่องว่างการปฏิบัติตามกฎระเบียบที่ได้รับการแก้ไข” หรือ “การตรวจสอบการปฏิบัติตามกฎระเบียบประจำปีที่ประสบความสำเร็จ” เป็นการใช้ประโยชน์จากความได้เปรียบในการแข่งขันที่ได้รับจากความเข้มงวดทางเทคนิคโดยตรง

VI. ข้อเสนอแนะเชิงกลยุทธ์และระบบนิเวศ AI ของประเทศไทย

การนำเสนอแนวทางปฏิบัติที่สามารถดำเนินการได้จริงสำหรับการนำไปใช้และการระดมทุนในบริบทของประเทศไทย

VI.A. การใช้ประโยชน์จากยุทธศาสตร์ AI แห่งชาติ

รัฐบาลไทยได้อนุมัติงบประมาณ 25,000 ล้านบาทสำหรับการพัฒนา AI และได้จัดตั้งศูนย์ความเป็นเลิศด้าน AI (AI Centres of Excellence – CoE) เก้าแห่ง 16 ซึ่งทำหน้าที่เป็นศูนย์กลางของความเชี่ยวชาญและนวัตกรรม 16

การจัดตำแหน่งเชิงกลยุทธ์: สตาร์ทอัพที่เน้น Deep Tech ควรจัดแนวทางแก้ไขปัญหาของตนให้สอดคล้องกับเป้าหมายของ CoE เหล่านี้ เช่น ศูนย์นวัตกรรม AI เพื่อสุขภาพและสุขภาวะ (AI Health and Wellness Centre), ศูนย์ความเป็นเลิศด้าน AI สำหรับการผลิต (AI Manufacturing Excellence Centre), และกลุ่มความร่วมมือด้านโมเดลภาษาขนาดใหญ่ภาษาไทย (Thai Language Large Model Consortium) 16

ตัวอย่างเชิงรุกคือ การพัฒนา Agent เขียนโค้ด AI ที่เน้นการสร้าง API ที่สอดคล้องกับ FHIR โดยเฉพาะสำหรับภาคส่วน HealthTech ในประเทศไทย สิ่งนี้จะเพิ่มโอกาสในการเข้าถึงเงินทุนวิจัยและพัฒนา (R&D grants) และการสนับสนุนจากภาครัฐโดยเฉพาะ

ช่องทางการระดมทุน: เงินทุนและความเชี่ยวชาญในท้องถิ่นมีอยู่แล้วในกองทุนร่วมลงทุนเชิงกลยุทธ์ขององค์กร (CVCs) เช่น KBTG Ventures ซึ่งมุ่งเน้นไปที่ FinTech, AI ในภาคธนาคาร, และ Embedded Finance 17 นอกจากนี้ True Digital Park Accelerator ก็เป็นอีกช่องทางหนึ่งที่ให้เงินทุนและการเข้าถึงระบบนิเวศเทคโนโลยีที่ใหญ่ที่สุดในเอเชียตะวันออกเฉียงใต้ 17 องค์กรเหล่านี้กำลังมองหาโซลูชันที่สามารถแก้ปัญหาระบบที่มีค่าใช้จ่ายสูงและมีความซับซ้อนในสภาพแวดล้อมที่มีการกำกับดูแล ซึ่งสอดคล้องอย่างสมบูรณ์กับวิทยานิพนธ์ Security-First

VI.B. แผนงานที่ปฏิบัติได้จริงสำหรับการนำไปใช้

การเปลี่ยนไปสู่การสร้างมูลค่าระดับพันล้านบาทผ่าน AI Coding ต้องมีการเปลี่ยนแปลงทางวัฒนธรรมและกระบวนการพัฒนาอย่างมีวินัย

- บังคับใช้กรอบการทำงาน Security-First: ดำเนินการตามขั้นตอน 5 ขั้นตอน (บริบท, การตรวจสอบความเข้าใจ, การเปลี่ยนแปลงทีละน้อย, การยอมรับด้วยตนเอง, การตรวจสอบที่ครอบคลุม) ทันทีในทุกทีมพัฒนา 1 สิ่งนี้ทำให้มั่นใจได้ว่า AI จะถูกใช้เป็นเครื่องมือที่ได้รับคำแนะนำอย่างเชี่ยวชาญ ไม่ใช่เป็นโซลูชันที่ครอบคลุมทุกอย่าง 1

- ลงทุนในเครื่องมือที่รับรู้บริบท: บูรณาการเครื่องมือ Prompt Engineering (เช่น LangSmith, Maxim AI) และกรอบการทำงานของ Agentic (Agent ที่เปิดใช้งาน MCP) เพื่อจัดการการโต้ตอบกับ LLM 6 อย่างไรก็ตาม ต้องจัดลำดับความสำคัญของการตรวจสอบโดยมนุษย์เหนือความเป็นอิสระของ Agent อย่างสมบูรณ์ 1

- ตรวจสอบผู้ตรวจสอบ (Audit the Auditor): ใช้ AI โดยเฉพาะเพื่อตรวจสอบโค้ดที่สร้างโดย AI สำหรับการปฏิบัติตามกฎระเบียบและรูปแบบความปลอดภัย (AI-assisted security review) 1 การทบทวนความปลอดภัยที่ใช้ AI ช่วยเหลือควรใช้ Prompt ที่กำหนดเองเพื่อตรวจสอบการปฏิบัติตามข้อกำหนดเฉพาะ (เช่น PCI DSS) 1 การดำเนินการนี้ทำให้มั่นใจได้ว่าผลผลิตที่เพิ่มขึ้นจะไม่ประนีประนอมกับขอบเขตการกำกับดูแล

- กำหนดเป้าหมายตลาดที่มีแรงเสียดทานสูง: พัฒนาโซลูชัน RegTech เฉพาะทางที่ทำให้การปฏิบัติตามกฎระเบียบและการตรวจสอบเป็นผลิตภัณฑ์ (เช่น Compliance-as-a-Service) สำหรับภาคส่วน FinTech หรือ HealthTech ของไทย 12 การดำเนินการนี้จะเพิ่มศักยภาพในการประเมินมูลค่าสูงสุดโดยการแก้ปัญหาด้านกฎระเบียบที่มีค่าใช้จ่ายสูงและมีความซับซ้อนอย่างเป็นระบบ 2 การลงทุนใน

วินัยด้านความปลอดภัย คือการลงทุนใน ความได้เปรียบทางการค้า ที่ไม่สามารถลอกเลียนแบบได้ง่าย 1

ผลงานที่อ้างอิง

- AI Coding Effectiveness 2025: Security Risks & Best Practice, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://www.ksred.com/ai-coding-effectiveness-in-2025-avoiding-critical-mistakes-and-security-risks-in-production/

- Custom Software Challenges & Fixes in Healthcare, Fintech, Logistics, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://www.peerbits.com/blog/healthcare-fintech-logistics-software-challenges-fixes.html

- Evaluating Code Quality of AI-generated Mobile Applications – DiVA portal, เข้าถึงเมื่อ ตุลาคม 2, 2025 http://www.diva-portal.org/smash/get/diva2:1972441/FULLTEXT01.pdf

- Prompt Engineering vs. Fine-Tuning—Key Considerations and Best Practices | Nexla, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://nexla.com/ai-infrastructure/prompt-engineering-vs-fine-tuning/

- Prompt Engineering or Fine-Tuning: An Empirical Assessment of LLMs for Code – arXiv, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://arxiv.org/html/2310.10508v2

- Best Prompt Engineering Tools (2025), for building and debugging LLM agents – Reddit, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://www.reddit.com/r/AI_Agents/comments/1mc4q9i/best_prompt_engineering_tools_2025_for_building/

- How AI Tools are Impacting the Startup Landscape – HubSpot, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://www.hubspot.com/startups/startup-ai-tools

- The Future of Workflows: No-Code AI Agents for Business Automation – Allganize AI, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://www.allganize.ai/en/blog/the-future-of-workflows-no-code-ai-agents-for-business-automation

- Model Context Protocol (MCP) and GitHub Copilot coding agent, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://docs.github.com/en/copilot/concepts/agents/coding-agent/mcp-and-coding-agent

- Exploring Autonomous Agents: A Closer Look at Why They Fail When Completing Tasks, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://arxiv.org/html/2508.13143v1

- Why Do Multi-Agent LLM Systems Fail? – arXiv, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://arxiv.org/pdf/2503.13657

- How AI Is Used In Fintech To Enhance Compliance And RegTech – NayaOne, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://nayaone.com/knowledgebase/how-ai-is-used-in-fintech-to-enhance-compliance-and-regtech/

- New Guidance: Integrating Artificial Intelligence into PCI Assessments, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://blog.pcisecuritystandards.org/new-guidance-integrating-artificial-intelligence-into-pci-assessments

- Automated PCI-DSS Compliance – Scytale, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://scytale.ai/pci-dss/

- Upgrading software business models to thrive in the AI era – McKinsey, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://www.mckinsey.com/industries/technology-media-and-telecommunications/our-insights/upgrading-software-business-models-to-thrive-in-the-ai-era

- B25 billion approved for AI development – Bangkok Post, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://www.bangkokpost.com/business/general/3078438/b25-billion-approved-for-ai-development

Top Startup Funding Sources in Thailand 2025, เข้าถึงเมื่อ ตุลาคม 2, 2025 https://abovea.tech/startup-funding-sources-thailand-2025/